본 포스팅은 스탠포드 Christopher Manning 교수님의 [Stanford CS224N: Natural Language Processing with Deep Learning]수업을 바탕으로 제작되었습니다. 이외에도 추가 설명이 필요한 개념 등 참고한 자료는 링크와 출처를 남겨두었습니다.

강의 영상 : https://www.youtube.com/watch?feature=shared&v=rmVRLeJRkl4

강의 자료 : https://web.stanford.edu/class/cs224n/slides/

개요

2023년을 강타한 openAI의 ChatGPT를 이어 구글의 Bard, 마이크로소프트의 Bing이 연달아 출시되며 온 사회가 생성형 AI 기반 언어 모델을 주목하고 있다. 자연스럽게 NLP(Natural Language Processin, 자연어처리) 기술의 수요도 증가하고 각광 받고 있다.

필자도 연구실에서 하는 프로젝트에 텍스트마이닝이 많이 쓰여서 LDA 토픽 모델링, 감성분석 등을 임의로 하고 있었는데, 자연어처리 기술의 개념과 원리를 깊이 이해하고 적절히 활용하고자 스탠포드의 딥러닝 기반 자연어 처리 강의를 수강하게 되었고, 배운 개념을 내 나름의 언어로 표현하고자 포스팅을 시작하게 되었다.

NLP란 무엇인가

- 자연어를 처리하는 목적은 컴퓨터가 자연어를 처리하여 이해할 수 있게 해주는 것이다. 0과 1로 정보를 처리하는 컴퓨터에게 복잡한 인간의 언어를 0과 1로 잘 변환해서 컴퓨터가 사람과 의사소통할 수 있도록 돕는 분야라고 할 수 있다.

- 인간의 언어는 0과 1로 표현하기에는 복잡하다. 같은 단어라고 할 지라도 맥락에 따라 다르게 쓰이며, 더 깊게 들어가면 말하는 사람의 표정, 손짓에 따라 다르게 쓰이기도 한다.

(고개를 저으며 “오 ~ 음식 맛있네 ~” 하는 것은 음식이 별로임을 비꼬는 맥락이다.) - 빅데이터 시대에 방대한 양의 비정형 데이터가 쏟아져 나오고 있다. NLP는 인간과 컴퓨터 상호작용을 돕는 인공지능의 한 분야이다.

(참고 : https://modulabs.co.kr/blog/natural-language-process-definition/, https://www.oracle.com/kr/artificial-intelligence/what-is-natural-language-processing/)

NLP의 두 가지 모델

다양하고 복잡한 인간 언어 시스템을 처리하는 자연어 처리 모델에는 크게 두 가지 방식이 있다.

첫 번째는 통계에 기초한 통계적 언어 모델 (Statistical Language Model, SLM)이고, 두 번째는 인공 신경망에 기초한 딥러닝 언어 모델(Deep Neural Network Language Model, DNN LM)이다.

- 통계적 언어 모델은 단어의 등장 횟수를 바탕으로 조건부 확률을 계산한다. 방대한 양의 텍스트 데이터를 학습하여, 어떤 문장에서 앞 단어가 주어지면 다음 단어가 나올 확률을 구하는 컨셉이다. 예를 들어 “나는 밥을” 이라는 문장이 주어지면 확률적으로 “먹는다.”라는 단어가 나올 확률이 크다는 것이다.

- 딥러닝 언어 모델은 통계적 언어 모델의 단점을 보완한 모델이라고 할 수 있다. 통계적 언어 모델은 조건부 확률을 구하기 위해 방대한 양의 데이터를 경험적으로 학습해야만 한다.(Sparsity Problem) 딥러닝 언어 모델은 신경망을 통해 단어간 유사도를 고려하여 앞 단어에 적절한 뒷 단어를 구한다. 예를 들어 앞이랑 똑같이 “나는 밥을” 이라는 문장이 주어졌을 때, 딥러닝 모델은 경험적인 확률이 아닌 “나”와 “밥”과 유사도가 높은 “먹는다” 라는 단어를 배치하는 것이다.

(참고 : https://velog.io/@kingjiwoo/2.언어모델Language-Model , https://velog.io/@milkbutterchesse/기초자연어처리-7.3신경망언어모델)

The Course

NLP의 두 가지 언어 모델 (SLM, DLM) 중에서 해당 강의는 DLM에 초점을 맞춰 NLP를 다룬다.

수업의 목표(곧 포스팅의 목표)는

1. NLP를 위한 딥러닝의 기초

2. 인간 언어와 컴퓨터 처리 간의 차이에 대한 큰 그림의 이해

3. NLP에서 발생하는 문제를 위한 시스템 구축

이다.

언어는 사람들로부터 이해되는 사회적 시스템이며, 모호함이 존재할 수 밖에 없다. 사람들 간의 언어에는 Phrasing(맥락 정도로 번역), 톤, 타이밍 등의 선택을 통한 같은 말이더라도 다른 표현이 존재한다.

NLP의 관심은 이런 복잡한 사람들의 언어를 컴퓨터로 이해하기 위해, 사람들이 어떤 목적으로 단어를 선택했는지 추측하는 것이라고 할 수 있다.

인간 언어의 흥미로운 점은 인류가 구축했다는 것이다. 인간의 지능에 대한 연구는 지속되어 왔다. 이 중에서도 언어의 역할은 중요했다. 비슷한 영장류와 다르게 인간은 강력한 커뮤니케이션을 통해 다른 생명체들보다 우세하게 했다. 자신의 생각을 말로 표현하고 글로 쓰는 것은 긴 기억을 갖게 되었고 지식이 거리와 시간과 상관 없이 전달되게 하였다.

결국 AI, HCI 관점에서 주요한 질문은 “컴퓨터가 인간의 언어에 담긴 정보를 어떻게 이해하느냐”에 있다.

Human Language and Word Meaning

인간은 책과 웹 등을 통해 다양한 언어로 텍스트를 남기고 있고, 이제는 제법 합리적으로 방대한 양의 텍스트 정보를 모국어로 이해할 수 있게 되었다.

- GPT-3 : 우리가 잘 알고 있는 OpenAI가 출시한 새로운 거대 언어 모델

다음 단어가 뭐가 올지 적기도 하고, 사용자가 쓴 문장에 대해 즉각적인 문장을 생성해낸다. 내가 필요한 작업을 입력하면 코드를 작성해주기도 한다.

이 모델이 대단한 이유는 universal model로써의 첫 걸음으로, 인간의 언어에 대한 모든 지식을 갖고 있는 모델로써의 첫 걸음이라는 것에 있다.

GPT3는 언어의 뜻을 알고 있다. 사용자가 어떤 일을 하고 싶은지 입력된 문장을 통해 의미를 파악해 의도를 파악한 답변을 준다.

Meaning of the word

언어의 의미는 Signifier (기표), Signified(기의)로 이루어진다. Signifier는 언어의 표시 자체, 즉 “산”이라는 단어 그 자체를 표시하는 기호 형태를 말하고, Signified는 “나무가 많고 푸른, 시원한 “ 등 산에 대해 우리가 생각하는 기호 의미를 뜻한다.

(출처 : https://m.blog.naver.com/dasan11/220340193155)

인간의 언어를 제대로 이해하기 위해 언어 모델은 기표 뿐 아니라 기의까지 파악하는 모델이어야 한다.

과거에 언어의 의미를 파악하는 작업은 WorNet이라 불리는 사전과 같은 것을 제작하여 동의어(synonym)와 상의어(hypernyms)(=단어 간의 관계)를 포함하는 리스트를 만들었다. 단어 간의 계층 구조를 통해 인간의 언어를 이해했다.

- WordNet의 문제

뉘앙스를 파악하기 어렵고, 단어의 새로운 뜻이 누락될 수 있다. 무엇보다 일일히 단어를 매핑해야 하므로, 사람의 노동력이 필요하다.

정확한 단어 간 유사성을 계산하기도 어렵다.- 전통적 언어 모델의 문제는 단어를 이산적인 기호로 생각하는 것이다. 즉 문장에서 작용하는 전역적인 의미를 파악하고자 하는 것이 아닌, 지역적인(localist) 의미만을 고려하는 것이다.이런 방식은 또한 단어 간의 유사성을 계산할 수 없다.

- 이런 지역적인 의미 고려는 단어의 갯수만큼 벡터 공간이 커지는 것을 의미하기도 한다. (단어의 갯수만큼 벡터화해서 의미를 저장하므로)

이런 식으로 Motel과 Hotel은 인간의 언어로는 유사한 의미로 사용되지만, 인코딩 방식으로 봤을 때 컴퓨터는 단어 간의 유사성을 구분할 수 없다. (예를 들어 전혀 다른 의미인 ‘사과’가 apple = [0000000000000100]으로 지정되면, 컴퓨터는 1의 갯수와 거리만 보고 사과, 모텔 간의 관계와 모텔, 호텔 관의 관계를 같다고 이해하게 된다. / 또한 수학적으로 봐도, 두 벡터의 관계는 직교하므로 유사성은 0이다.)

- Distribution Semantics

“You shall know a word by the company it keeps”

통계적 자연어 처리의 가장 성공적인 아이디어 : 하나의 단어와 함께 쓰인 단어들은 같은 맥락이다.

유사한 문맥에 나타나는 단어의 벡터와 유사하도록 선택된 각 단어에 대해 밀집된 벡터(dense vector)를 구축하고 벡터 내적(스칼라)으로 유사성을 측정

→ 이 때 만들어진 단어 벡터들을 word embeddings라고 한다.

이런 식으로 표현된 단어는 더 이상 지역적인 의미를 갖지 않는다. 사용자가 지정한 n개 차원에서의 의미를 갖기 때문에, 맥락에 따라 표현될 수 있게 되고 이것을 distributed representation 되었다고 표현한다.

Word2vec introduction

- Word2Vec

- 단어 벡터를 학습하는 프레임워크

큰 말뭉치(corpus)를 가지고 있을 때 사전에 있는 모든 단어를 벡터로 표현 - 각각의 단어가 가질 최적의 벡터는 무엇인가?

에 대하여, 다음과 같은 알고리즘으로 유사도를 계산하는 연산을 수행한다.

- 단어 벡터를 학습하는 프레임워크

- center word “c”와 context(outside) words o에 대해, 각각의 위치(c의 위치인 t에 대해)를 갖도록 부여

- c와 o 사이의 유사도를 측정하여 c에 대한 o의 확률 계산 → 확률을 최대화하도록 계산 반복 (t의 위치를 변경해가면서 수행)

Word2vec objective function gradients

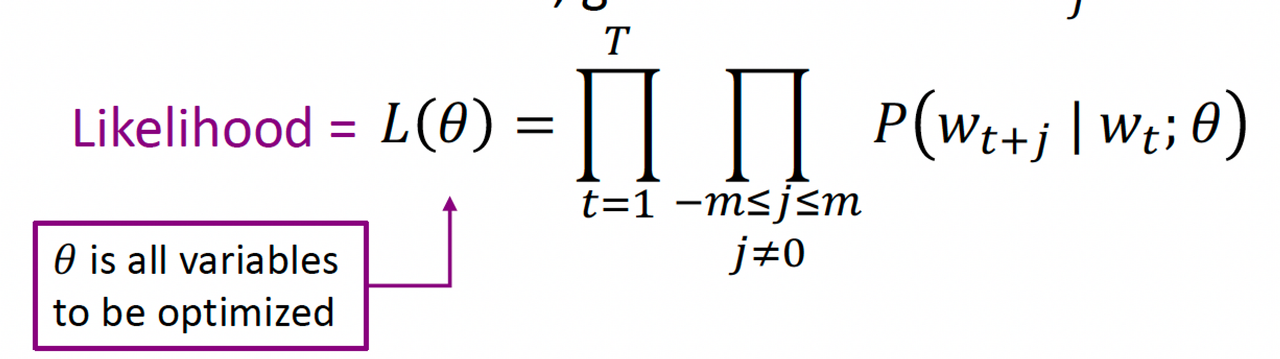

- Word2Vec의 목적 함수

- 다른 머신러닝 방법과 비슷하게 Word2vec 역시 예측의 정확도를 최대화하기 위해 목적함수(비용함수)를 최소화하는 방법을 사용한다.

- 각각의 위치 t(1…T)에 대해, 중심 단어 Wj들에 대해 m개의 문맥 단어의 조건부 확률의 곱이 Wordvec에서의 우도함수이다.

중심단어에 대한 문맥단어의 조건부 확률을 어떻게 구하는가 ?

단어 w에 대하여, 벡터 v_w가 w가 중심단어일 때 벡터이고 벡터 u_w가 u가 문맥단어일 때 벡터라면 조건부 확률은 다음과 같이 계산된다.

- 내적을 통해 o와 c의 유사도 구하기 : 높은 내적값이 높은 확률(유사도)이다. (→ 분자항)

- 지수화(exponentiation)해서 모든 값을 양수로 바꾼다. (분모, 분자 모두)

- 확률은 음수일 수 없으므로

- 모든 어휘에 확률값을 부여하기 위해 정규화한다. (→ 분모항)

- 1로 정규화를 진행함

이 모든 과정이 Softmax Function이다. softmax는 특이한 단어에도 작은 확률이라도 부여한다.

우도함수의 목적함수는 우도함수를 로그화하여 계산을 쉽게 한 후, 음수를 취하여 최소를 구하는 문제로 변형시킨 Negative Log Likelihood 함수이다. Gradient Descent를 이용하면 최소값을 구하는 문제를 풀 수 있다.

어떻게 하면 손실(목적함수)를 최소화할 수 있을 것인가?

theta는 모델의 모든 파라미터를 표현하는 하나의 긴 벡터이고, 이 경우 d개의 차원을 가진 V개의 단어의 집합이 벡터를 구성한다. 모든 단어는 중심단어일 때 v, 문맥단어일 u로 총 두 개의 벡터를 갖는다. 그러므로 theta 벡터의 크기는 d X V X 2(두 개의 벡터)인 것이다.

손실함수를 최소화하기 위해서는 모든 벡터들의 gradients를 계산해야 한다.

손실함수 계산법

알고리즘의 핵심은 중심단어의 변화에 따라, 비용함수를 최소화하는 것이므로, 변수는 중심단어 벡터 (V_c)이다. V_c를 미분하여 미분값이 0이 되는 파라미터를 찾으면 된다.

(1) 분자항의 미분결과이다. log와 지수는 상쇄되고, v_c는 미분하여 1이 되므로 u_0 벡터만 남는다.

(2) 분모항의 미분은 조금 복잡하다. 함수 안에 함수가 있는 꼴이기 때문이다. (log 뒤에 시그마가 있는 꼴) 이 때는 Chain Rule을 사용해야 한다.

chain rule을 적용하여 log 함수의 도함수와 시그마 안에 있는 지수 함수의 도함수를 구한 값은 다음과 같다.

최종적으로 구해진 손실함수는 다음과 같고, 첫 번째 항이 미분된 값(u_0)은 곧 관측치(observation)을 의미하므로, 손실함수의 v_c에 대한 미분값은 관측치에서 기댓값을 뺀 값이 된다.

손실함수가 최소가 되는 지점을 찾기 위한 알고리즘이 경사하강법(gradient descent algorithm)이며, 다음 시간에 optimization basic과 함께 다루도록 하겠다.

배우는 과정에서 작성하다 보니 부족한 점이 많고 틀린 점이 있을 수 있습니다.

혹시 설명이 추가적으로 필요한 부분이나 수정해야 할 부분 발견하시면 피드백 주시면 감사하겠습니다.